O desafio de lidar com um modelo de aprendizado profundo é muitas vezes entender por que ele faz o que faz: sejam as repetidas sessões de luta do xAI para ajustar as políticas estranhas de Grok, as lutas do ChatGPT com a bajulação ou as alucinações comuns, canalizar através de uma rede neural com bilhões de parâmetros não é fácil.

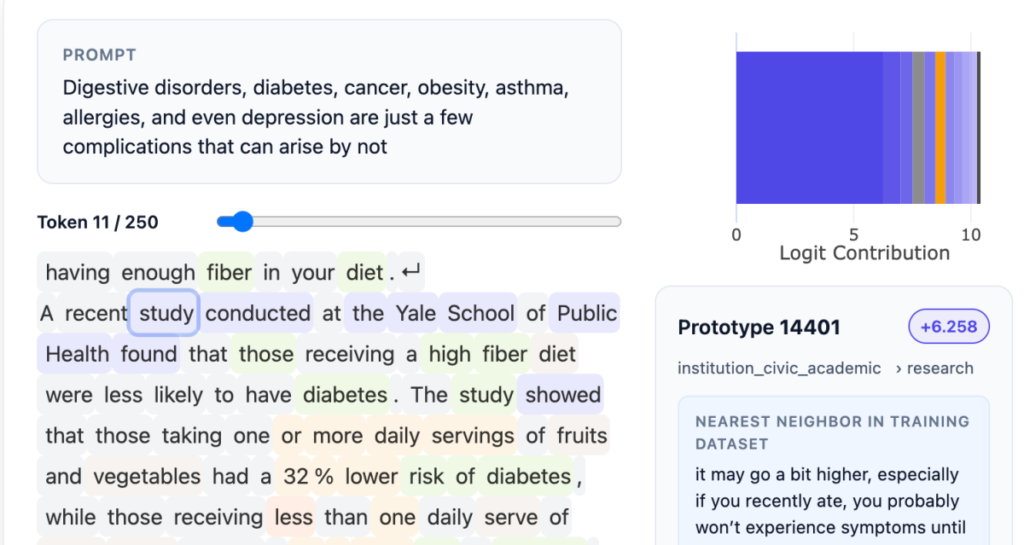

A Guide Labs, uma start-up de São Francisco fundada pelo CEO Julius Adebayo e pela diretora científica Aya Abdelsalam Ismail, está oferecendo hoje uma resposta para esse problema. Na segunda-feira, a empresa abriu o código-fonte de um LLM de 8 bilhões de parâmetros, Direção-8Btreinado com uma nova arquitetura projetada para tornar suas ações facilmente interpretáveis: cada token produzido pelo modelo pode ser rastreado até suas origens nos dados de treinamento do LLM.

Isso pode ser tão simples quanto determinar os materiais de referência para os fatos citados pelo modelo, ou tão complexo quanto compreender a compreensão do modelo sobre humor ou gênero.

“Se eu tenho um trilhão de maneiras de codificar gênero, e eu o codifico em 1 bilhão dos 1 trilhão de coisas que tenho, você tem que ter certeza de encontrar todos esses 1 bilhão de coisas que eu codifiquei, e então você tem que ser capaz de ligá-los e desligá-los com segurança”, disse Adebayo ao TechCrunch. “Você pode fazer isso com os modelos atuais, mas é muito frágil… É uma das questões do Santo Graal.”

Adebayo começou este trabalho enquanto fazia seu doutorado no MIT, sendo coautor de um livro amplamente citado documento de 2020 que mostrou que os métodos existentes de compreensão dos modelos de aprendizagem profunda não eram confiáveis. Esse trabalho acabou levando à criação de uma nova maneira de construir LLMs: os desenvolvedores inserem uma camada de conceito no modelo que agrupa os dados em categorias rastreáveis. Isso requer mais anotações de dados iniciais, mas usando outros modelos de IA para ajudar, eles foram capazes de treinar esse modelo como sua maior prova de conceito até então.

“O tipo de interpretabilidade que as pessoas fazem é… neurociência baseada em um modelo, e nós invertemos isso”, disse Adebayo. “O que fazemos é, na verdade, projetar o modelo desde o início, para que você não precise fazer neurociência.”

Uma preocupação com esta abordagem é que ela pode eliminar alguns dos comportamentos emergentes que tornam os LLMs tão intrigantes: a sua capacidade de generalizar de novas maneiras sobre coisas nas quais ainda não foram treinados. Adebayo diz que isso ainda acontece no modelo de sua empresa: sua equipe rastreia o que chama de “conceitos descobertos” que o modelo descobriu por conta própria, como a computação quântica.

Evento Techcrunch

Boston, MA

|

9 de junho de 2026

Adebayo argumenta que essa arquitetura interpretável será algo de que todos precisam. Para LLMs voltados para o consumidor, essas técnicas devem permitir que os criadores de modelos façam coisas como bloquear o uso de materiais protegidos por direitos autorais ou controlar melhor os resultados em torno de assuntos como violência ou abuso de drogas. As indústrias regulamentadas exigirão LLMs mais controláveis, por exemplo em finanças, onde um modelo que avalia os requerentes de empréstimos precisa de considerar coisas como registos financeiros, mas não raça. Há também necessidade de interpretabilidade no trabalho científico, outra área onde a Guide Labs desenvolveu tecnologia. O dobramento de proteínas tem sido um grande sucesso nos modelos de aprendizagem profunda, mas os cientistas precisam de mais informações sobre por que seu software descobriu combinações bem-sucedidas.

“Este modelo demonstra que o treinamento de modelos interpretáveis não é mais um tipo de ciência; é agora um problema de engenharia”, disse Adebayo. “Nós descobrimos a ciência e podemos escalá-los, e não há razão para que isso não corresponda ao desempenho dos modelos de nível de fronteira”, que têm muito mais parâmetros.

Guide Labs afirma que Steerling-8B pode atingir 90% da capacidade dos modelos existentes, mas usa menos dados de treinamento, graças à sua arquitetura inovadora. O próximo passo para a empresa, que emergiu do Y Combinator e levantou uma rodada inicial de US$ 9 milhões do Capital Inicializado em novembro de 2024, é construir um modelo maior e começar a oferecer API e acesso de agência aos usuários.

“A forma como usamos os modelos de treinamento atuais é super primitiva e, portanto, democratizar a interpretabilidade inerente será, na verdade, uma coisa boa a longo prazo para nossa raça humana”, disse Adebayo ao TechCrunch. “Como buscamos esses modelos que serão superinteligentes, você não quer que algo tome decisões em seu nome que sejam meio misteriosas para você.”