Democratas do Congresso em o Comitê Econômico Misto divulgou um relatório esta semana identificando mais de US$ 20,9 bilhões em perdas de consumidores decorrentes de roubo de identidade resultante de quatro grandes violações de corretoras de dados. A senadora dos EUA Maggie Hassan lançou a investigação em agosto, após uma investigação de A marcação e CalMatterscopublicado pela WIRED, descobriu que alguns corretores de dados estavam ocultando ferramentas de exclusão do Google e outros motores de busca.

A recente divulgação pelo Departamento de Justiça dos EUA de 3 milhões de documentos relacionados ao criminoso sexual condenado Jeffrey Epstein incluiu intimações do grande júri ao Google que esclarecer como os investigadores federais interagem com empresas de tecnologia e como respondem aos pedidos de informação do governo.

O cartel de drogas mexicano CJNG pode sobreviver ao assassinato de seu líder de longa data, Nemesio “El Mencho” Oseguera Cervantes, em parte graças a seu uso prolífico de tecnologias como drones, mídias sociais e IA. Entretanto, a Marinha Mexicana anunciou na quinta-feira que apreendeu um navio semissubmersível que transportava quase 4 toneladas de cocaína como parte de uma iniciativa recente para impedir o tráfico de drogas no Oceano Pacífico. O esforço surge no momento em que os EUA lançam a sua própria campanha contra o tráfico marítimo através de uma série de ataques mortais a barcos no Caribe.

Enquanto isso, à medida que agentes assistentes de IA como o OpenClaw explodem em popularidade – e semeiam o caos pela web – um novo projeto de código aberto chamado IronCurtain está usando um design exclusivo para proteger e restringir a IA agente antes que ela se torne desonesta.

E tem mais. Toda semana, reunimos notícias sobre segurança e privacidade que não abordamos em profundidade. Clique nas manchetes para ler as histórias completas. E fique seguro lá fora.

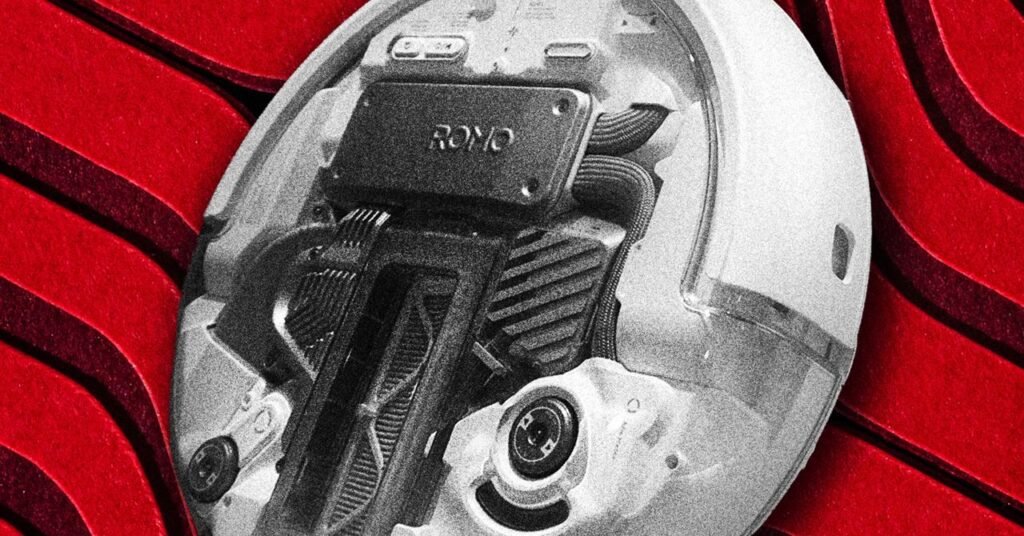

Colocar um robô autônomo habilitado para Internet solto em sua casa deve dar a qualquer um um momento de pausa. Quando esse robô é um aspirador de pó móvel equipado com uma câmera e um microfone que pode ser sequestrado de qualquer lugar do mundo com nada mais do que seu número de série, ele se torna uma verdadeira história de terror sobre privacidade.

Um desses proprietários de robovac, Sammy Azdoufal, descobriu essa absurda vulnerabilidade de segurança ao tentar um experimento pilotando seu aspirador robô DJI Romo com um controlador PS5. Ele descobriu que poderia controlar 6.700 robôs em 24 países ao redor do mundo, com acesso total às plantas baixas que eles geraram das casas de seus proprietários e aos seus feeds de vídeo e áudio. Quando The Verge contatou Azdoufal, ele conseguiu acessar instantaneamente um Romo de propriedade de um funcionário da agência de notícias de tecnologia apenas sabendo seu número de série de 14 dígitos. DJI agora corrigiu a vulnerabilidade em resposta a Azdoufal, essencialmente twittando suas descobertas ao vivo. Mas a história, no entanto, levanta sérias questões sobre a segurança de outros dispositivos de internet das coisas habilitados para áudio ou vídeo – sem mencionar aqueles capazes de circular livremente pela sua casa.

Embora o Departamento da Pátria tenha recebido enorme poder sob a administração Trump na sua missão de deportar milhões de imigrantes, a organização dentro do DHS que serve como principal defensora cibernética dos Estados Unidos, a Agência de Segurança Cibernética e de Infraestruturas, foi negligenciada. Agora, o seu diretor interino, Madhu Gottumukkala, foi substituído enquanto a CISA procura encontrar uma nova base.

Mesmo antes dessa notícia, CyberScoop esta semana relatado sobre as crises que assolaram a agência durante todo o primeiro ano desde a posse de Trump: um terço do pessoal foi despedido e divisões inteiras da agência foram encerradas. As nomeações para um diretor permanente foram bloqueadas no Congresso. As suas capacidades diminuíram e as organizações que procuraram a CISA em busca de assistência e parcerias procuraram outro lugar. Gottumukkala sofreu seus próprios escândalos mais pessoais, como a demissão de pessoal de segurança depois de ter falhado no teste do polígrafo e o compartilhamento de contratos confidenciais no ChatGPT. Agora, Nick Andersen, que atuou como diretor executivo de segurança cibernética da CISA, substituirá Gottumukkala na sitiada agência.

Um investigador do King’s College London colocou três grandes modelos de linguagem populares uns contra os outros em cenários simulados de jogos de guerra e descobriu que, 95 por cento das vezes, pelo menos um dos modelos optou por utilizar armas nucleares tácticas. O pesquisador também encontradoquando um modelo de IA implantou uma arma nuclear tática, seu oponente de IA apenas diminuiu um quarto das vezes. Nenhuma das empresas por trás dos três modelos – OpenAI, Google e Anthropic – respondeu ao pedido de comentários da New Scientist.

O papel da IA no combate à guerra ganhou destaque esta semana. A Anthropic e o Departamento de Guerra estão envolvidos em uma disputa contratual sobre se os modelos de IA da Anthropic podem ser usados para alimentar armas totalmente autônomas e vigilância doméstica em massa. Dario Amodei, CEO da Anthropic, escreveu em um declaração que estes tipos de casos de utilização “podem minar, em vez de defender, os valores democráticos”. Por sua vez, o presidente Donald Trump ameaçou proibir o uso de produtos antrópicosincluindo seu chatbot Claude, dentro do governo dos EUA. Enquanto isso, centenas de funcionários do Google e da OpenAI assinaram um carta aberta pedindo aos seus chefes que “deixem de lado as suas diferenças e se unam para continuar a recusar as atuais exigências do Departamento de Guerra de permissão para usar os nossos modelos de vigilância doméstica em massa e de matar pessoas de forma autónoma, sem supervisão humana”.

Um novo aplicativo para telefones Android chamado Close Glasses permite que os usuários procurem óculos inteligentes nas proximidades, revelando a presença de dispositivos vestíveis, que às vezes são indistinguíveis dos óculos normais e permitem que os usuários gravem as pessoas sem o seu conhecimento. O aplicativo procura assinaturas Bluetooth exclusivas emitidas pelos óculos e envia aos usuários uma notificação se detectar uma fonte próxima.

O desenvolvedor disse à 404 Media que se inspirou para construir o aplicativo depois de ler sobre vários incidentes envolvendo óculos inteligentes. Durante o verão, a 404 Media informou que um agente da Alfândega e Proteção de Fronteiras havia vestido um par durante uma operação de imigração, e neste outono o veículo também informou que os homens estavam usando óculos inteligentes para trabalhadores de salão de massagens de filmesaparentemente sem o seu conhecimento ou consentimento. Em fevereiro, o New York Times relatado que um desenvolvedor de óculos inteligentes, Meta, tinha planos de integrar o reconhecimento facial em seus óculos, gerando novas preocupações entre os especialistas em privacidade.